Das Problem ist nicht die KI. Das Problem ist, woher sie ihre Antworten holt.

Wer heute ChatGPT, Gemini oder ähnliche Tools im Unternehmen einsetzt, stellt früher oder später fest: Die KI antwortet schnell, flüssig – und manchmal schlicht falsch. Sie erfindet Zahlen. Sie nennt Quellen, die nicht existieren. Sie beschreibt Produkte oder Prozesse, die veraltet oder nie korrekt waren. Dieses Phänomen hat einen Namen: Halluzination. Und es hat eine technische Ursache.

Wie Standard-KI funktioniert – und warum sie halluziniert

Ein Sprachmodell wie GPT-4 wird auf einem riesigen Textkorpus trainiert. Dieser Datensatz hat ein festes Enddatum. Was danach passiert ist, weiss das Modell nicht. Was in deinem Unternehmen gilt – aktuelle Tarife, Reglemente, Produkte – steht nirgendwo in seinen Trainingsdaten.

Wenn du das Modell trotzdem fragst, antwortet es trotzdem. Es extrapoliert. Es rät. Es klingt dabei selbstbewusst, weil Sprachmodelle keine Unsicherheit signalisieren, wenn sie keine haben sollten.

Studien zeigen: Bei faktischen Fragen halluzinieren aktuelle Sprachmodelle in 15 bis 25 Prozent der Fälle. Das klingt abstrakt – bis man sich überlegt, was das im Unternehmenskontext bedeutet.

Ein konkretes Beispiel: Eine Pensionskasse setzt einen Standard-KI-Chatbot ein. Ein Versicherter fragt nach dem aktuellen Umwandlungssatz. Das Modell antwortet mit einem Wert aus seinen Trainingsdaten – der seit zwei Jahren nicht mehr gilt. Der Versicherte plant seine Pensionierung auf Basis einer falschen Zahl. Der Unterschied kann mehrere tausend Franken Jahresrente betragen.

Gleiches gilt für HR-Abteilungen mit veränderten Ferienreglementen, für Rechtsabteilungen mit aktualisierten Compliance-Vorgaben, für Kundendienste mit neuen Produkttarifen.

Halluzination ist kein Bug. Es ist das Verhalten eines Systems, das auf Wahrscheinlichkeit optimiert ist – nicht auf Wahrheit.

Was RAG anders macht

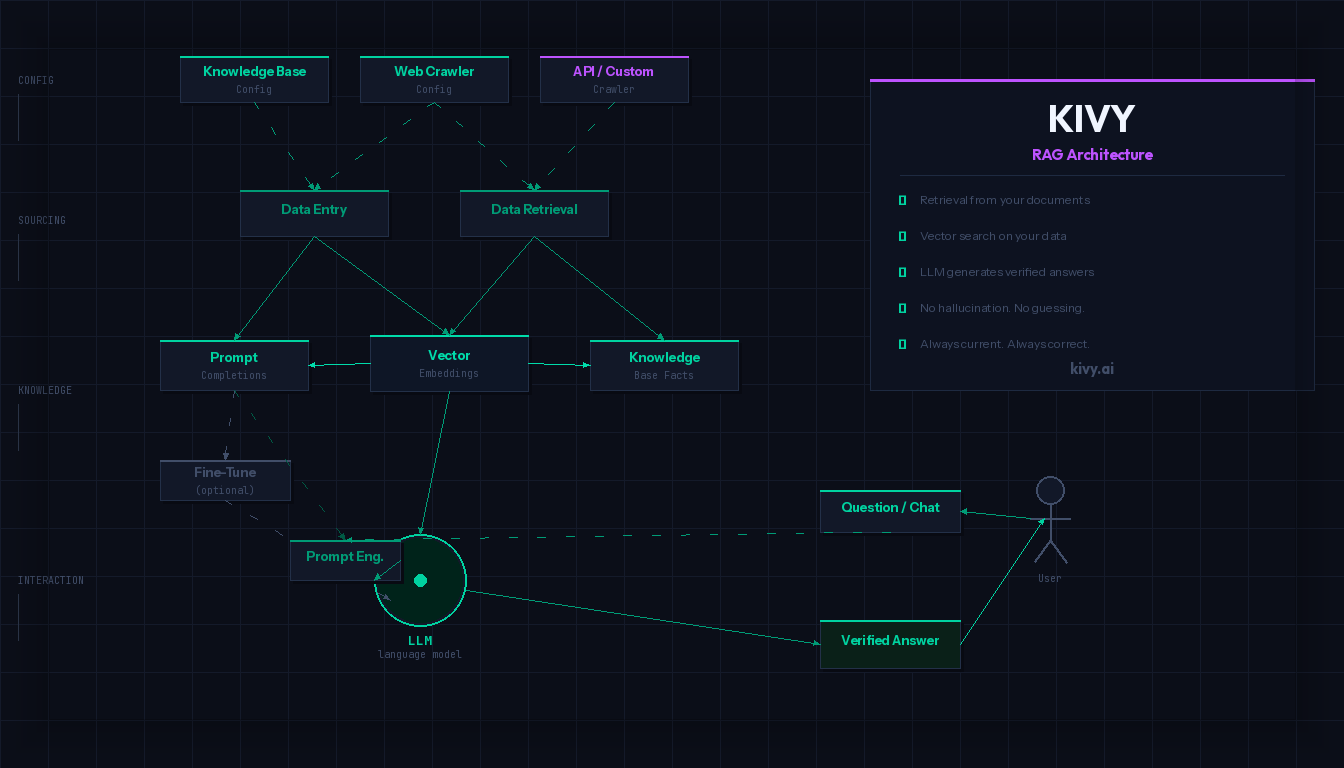

RAG steht für Retrieval Augmented Generation. Der Ansatz ist konzeptionell einfach – und verändert alles.

Statt direkt aus dem Trainingswissen zu antworten, führt ein RAG-System zuerst eine gezielte Suche durch: in deinen eigenen Dokumenten, Handbüchern, Datenbanken, Wissenssystemen. Erst wenn die relevanten Informationen gefunden und geprüft sind, formuliert das Sprachmodell eine Antwort – auf Basis dieser konkreten Quellen.

Das Prinzip in drei Schritten:

| Schritt | Was passiert |

|---|---|

| 1. Retrieve | Das System durchsucht deine eigenen Dokumente nach relevanten Inhalten |

| 2. Augment | Die gefundenen Informationen werden dem Sprachmodell als Kontext übergeben |

| 3. Generate | Das Modell formuliert eine Antwort – ausschliesslich auf Basis dieser Quellen |

Das Modell erfindet nichts. Es fasst zusammen, was wirklich in deinen Unterlagen steht. Und weil du die Dokumente kontrollierst, kannst du jederzeit prüfen, woher eine Antwort stammt.

Standard-KI vs. RAG: Der direkte Vergleich

| Dimension | Standard-KI (z.B. ChatGPT) | RAG-System (z.B. KIVY) |

|---|---|---|

| Datenquelle | Trainingsdaten (Stichtag) | Deine aktuellen Dokumente |

| Aktualität | Veraltet nach Trainingsende | Immer aktuell |

| Nachvollziehbarkeit | Keine Quellenangabe möglich | Jede Antwort ist quellenbasiert |

| Halluzinationsrisiko | 15–25% bei Faktenfragen | Stark reduziert durch Grounding |

| Unternehmenskontext | Nicht vorhanden | Vollständig integriert |

| Kontrollierbarkeit | Keine | Inhalte jederzeit aktualisierbar |

Wie KIVY das in der Praxis umsetzt

KIVY ist eine RAG-basierte Plattform für Unternehmen, die KI produktiv und zuverlässig einsetzen wollen. Das System verbindet ein Sprachmodell mit dem eigenen Wissenssystem der Organisation – ob Website-Inhalte, interne Dokumente, Produktdatenbanken oder strukturierte Wissensdatenbanken.

Ein konkretes Szenario: Eine Organisation mit 600 internen Dokumenten – Reglemente, FAQs, Produktinformationen, Prozessbeschreibungen – verbindet diese via KIVY mit einem LLM. Mitarbeitende oder Kundinnen stellen Fragen in natürlicher Sprache. KIVY sucht zuerst in den 600 Dokumenten, identifiziert die relevantesten Abschnitte und übergibt sie dem Sprachmodell als Kontext. Die Antwort kommt ausschliesslich aus diesen Quellen – mit Quellenangabe, nachvollziehbar, aktualisierbar.

Typische Einsatzbereiche:

- Kundenservice: Chatbots, die aktuelle Produktinfos, Tarifdaten und FAQs korrekt beantworten

- Pensionskassen und Versicherungen: Rechtssichere Auskünfte auf Basis aktueller Reglemente

- HR und Intranet: Mitarbeitende erhalten korrekte Antworten auf Policy-Fragen

- Bildung und öffentliche Verwaltung: Bürgerservices und Studierendenberatung ohne Fehlinformationen

Das ist kein Marketing. Das ist Architektur.

Der Unterschied zwischen Standard-KI und RAG ist kein Feature, das man ein- oder ausschalten kann. Es ist eine fundamentale Frage der Systemarchitektur.

Standard-KI ist ein geschlossenes System. Es weiss, was es beim Training gelernt hat – und füllt Lücken mit Wahrscheinlichkeiten. RAG ist ein offenes System. Es verbindet das Sprachmodell mit einer aktuellen, verifizierbaren Wissensbasis.

Für Unternehmen, die KI nicht nur demonstrieren, sondern produktiv betreiben wollen, ist dieser Unterschied entscheidend. Eine falsche Auskunft, eine halluzinierte Gesetzesgrundlage, ein erfundener Produktpreis: Das sind keine theoretischen Risiken. Das sind Situationen, die täglich passieren, wenn KI ohne Grounding eingesetzt wird.

Häufig gestellte Fragen zu RAG

Was bedeutet RAG? RAG steht für Retrieval Augmented Generation. Es ist eine KI-Architektur, bei der ein Sprachmodell vor der Antwortgenerierung gezielt relevante Informationen aus einer externen Wissensdatenbank abruft.

Warum halluziniert ChatGPT? ChatGPT und andere Sprachmodelle sind auf Wahrscheinlichkeit trainiert, nicht auf Faktenprüfung. Ohne Zugang zu aktuellen, verifizierten Quellen füllen sie Wissenslücken mit plausibel klingenden, aber potenziell falschen Informationen.

Was ist der Unterschied zwischen RAG und Fine-Tuning? Fine-Tuning passt das Modell selbst an – es ist aufwendig, teuer und veraltet mit der Zeit. RAG verbindet ein unverändertes Modell mit einer externen, aktuell gehaltenen Wissensbasis. Für die meisten Unternehmensanwendungen ist RAG die pragmatischere und sicherere Wahl.

Wie aktuell sind die Antworten in einem RAG-System? So aktuell wie die Dokumente, die du im System hinterlegst. Du kontrollierst die Wissensbasis – und damit die Korrektheit der Antworten.

Fazit

Halluzination lässt sich nicht durch bessere Prompts lösen. Es ist ein strukturelles Merkmal von Sprachmodellen ohne Grounding. RAG löst dieses Problem auf Architekturebene: Die KI antwortet nicht mehr aus dem Bauch heraus – sondern aus deinen Daten. Immer korrekt. Immer nachvollziehbar. Immer aktuell.

Wer KI ernsthaft im Unternehmen einsetzen will, kommt an RAG nicht vorbei.